1、功能区分虽然tokenizer和embeddingtokenizer的过程看起来类似于“编码”tokenizer,但它们与Transformer中的encoder层的功能是不同的tokenizer和embedding是数据预处理步骤,而encoder是模型架构中的一个组件,用于处理输入序列并生成上下文感知的表示三通俗解释 tokenizer想象一下你有一本字典,tok。

2、Tokenizer分词器是一种工具,它将一段文本分割成很多单词或者子单词,这些单词或子单词通过token词表被映射成一串id简而言之,Tokenizer的作用是将字符序列转化为数字序列,以便作为模型的输入由于神经网络模型无法直接处理文本数据,因此tokenizer我们需要先用分词器将文本转换为数字形式,这个过程被称为编码Encodi。

3、Tokenizer是Transformer大模型理解文本图像的第一道关卡,作为模型的输入subword方法BPEWordPiece是当前大模型的主流,平衡了语义表达与计算效率此外,值得注意的是,output token的价格通常比input token更贵,这可能与模型在处理输出时需要更多的上下文信息和精细的语义理解有关。

4、Tokenize是将文本或语言转化为Token的过程这个过程通常包括将文本按照一定的规则切割成单词标点符号等语言元素,并可能进行一些额外的处理,如去除停用词转换为小写等例如,对于句子quotHello, world!quot,Tokenize的过程可能将其转化为一个Token序列quot#39Hello#39, #39,#39, #39world#39, #39!#39quotTokenizer是。

5、解码大语言模型Tokenizer词汇量向量量化与码本Tokenizer Tokenizer,即分词器,是文本处理的第一步,负责将输入文本分解为更小单元token在大语言模型中,Tokenizer是文本预处理阶段的核心,因为模型无法直接处理原始文本字符串常见的Tokenizer类型包括词级别的Tokenizer将文本分解为单词,例如“。

6、主要有BPEBBPEWordPiece和UniLM等分词算法BPE通过迭代地合并最频繁出现的字符或字符序列生成词表,是目前最常用的Tokenizer方法之一BBPE基于字节Byte层面生成词表,能较好支持多种语言WordPiece基于语言模型似然概率生成新的子词UniLM则是在构建足够大词表后,通过删除计算概率低的子词调整词。

7、token令牌tokenize令牌化tokenizer令牌解析器 2另一种翻译是token可以翻译为“标记”,tokenize可以翻译为“标记解析”或“解析标记”,tokenizer可以翻译为“标记解析器”在编写词法分析器Lexer或语法分析器Parser的时候,除了Lexer和Parser这两个词会经常使用外,tokenize和tokenizer也会经常。

8、Token是词汇单元,Tokenize是将文本转换为Token序列的过程,Tokenizer是执行Tokenize操作的工具或函数1 Token 在自然语言处理和文本分析中,Token通常指的是一个最小的有意义的语言单位 在英文中,一个Token可以是一个单词,如rdquoapplerdquordquobookrdquo等 在中文中,一个Token。

9、Token是文本或语言中的基本单位,通常指一个单词标点符号或其tokenizer他语言元素,是文本分析的基础Tokenize是将文本或语言转化为Token的过程这个过程包括将文本按照一定的规则切割成单词标点符号等语言元素,并可能进行一些额外的处理,如去除停用词转换为小写等Tokenizer是进行Tokenize操作的工具或库在。

10、tokenizer,或称分词器,其目标是将字符序列转化为数字序列,适应模型输入不同语言的编码方式各异,例如英语通常使用GBK,中文则需UTF8分词策略依据粒度有以下几种Wordbased 每个单词分配一个ID,词汇表大小与语料相关,缺点是可能导致词义相近的词被拆分,如quotcatquot和quotcatsquotCharacterbased。

11、1 理解TokenToken是一种数据结构,它在计算机科学中广泛应用于各种场景,比如在编程语言中代表文本中的一个元素,如关键字标识符或符号2 解释TokenizeTokenize是一个过程,即将文本分割成一系列的Token这个过程通常在编译器的词法分析阶段进行,用于识别源代码中的基本元素3 说明TokenizerToke。

12、Tokenizer是NLP任务中将自然语言文本转换为机器可理解的数字的步骤它是文本预处理的重要部分,通过将文本转化为tokens并使用唯一的tokens生成词汇表,每个tokens在词汇表中的ID作为数字表示该tokentokens可以是单词子单词或字符以下是将文本转换为数字的完整过程,但我们将重点放在tokenization模型阶段基于单词的toke。

13、大模型Tokenizer核心算法笔记 一Tokenizer的基本概念 Tokenizer是自然语言处理中的一个关键组件,它的核心任务是将文本映射为ID序列,供模型处理具体来说,Tokenizer将文本拆分成更小的单元,这些单元被称为词元Token与ASCII编码不同,Token化的本质是从单字符映射到语义单元,一个Token能代表一个。

14、字节对编码BytePair Encoding,简称BPE是一种压缩文本的算法,最初被OpenAI应用于训练GPT模型,现广泛用于包括GPTGPT2RoBERTaBART和DeBERTa在内的多种Transformer模型Tokenizer在自然语言处理中承担着将连续文本序列分解为有意义标记tokens的重要角色,这些标记可以是单词数字符号或其tokenizer他。

15、OpenAI大模型高效Tokenizertictoken tictoken是OpenAI为其系列大模型开发的一款高效tokenizer库,尤其在编码速度上表现出色以下是对tictoken的详细解析一词表大小与速度对比 tictoken在编码速度上具有显著优势虽然对于单个句子的推理,速度的差距可能并不明显,但随着编码文本长度的增加,以及用户场景对。

16、Transformer的tokenizer是用于将文本转化为模型可处理的数字序列的工具以下是关于Transformer的tokenizer的详细解释定义与功能Tokenizer是实现文本到数字序列转换功能的算法或实例功能将输入文本进行tokenize,即转化为数字表示的序列,便于Transformer模型处理常用工具SentencePiece一种用于tokenization的。

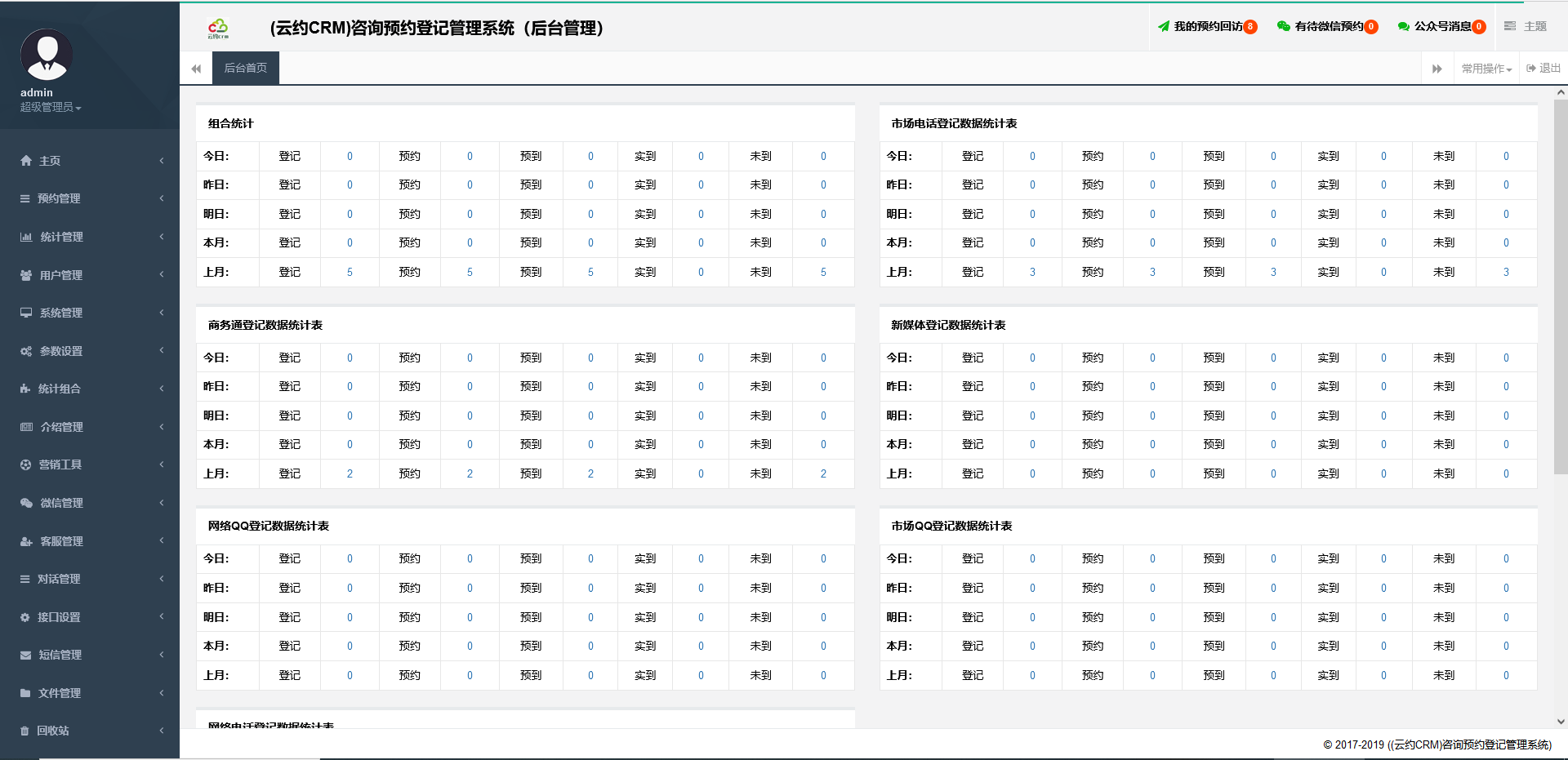

微信医疗(登记+咨询+回访)预约管理系统

微信医疗(登记+咨询+回访)预约管理系统  云约CRM微信小程序APP系统定制开发

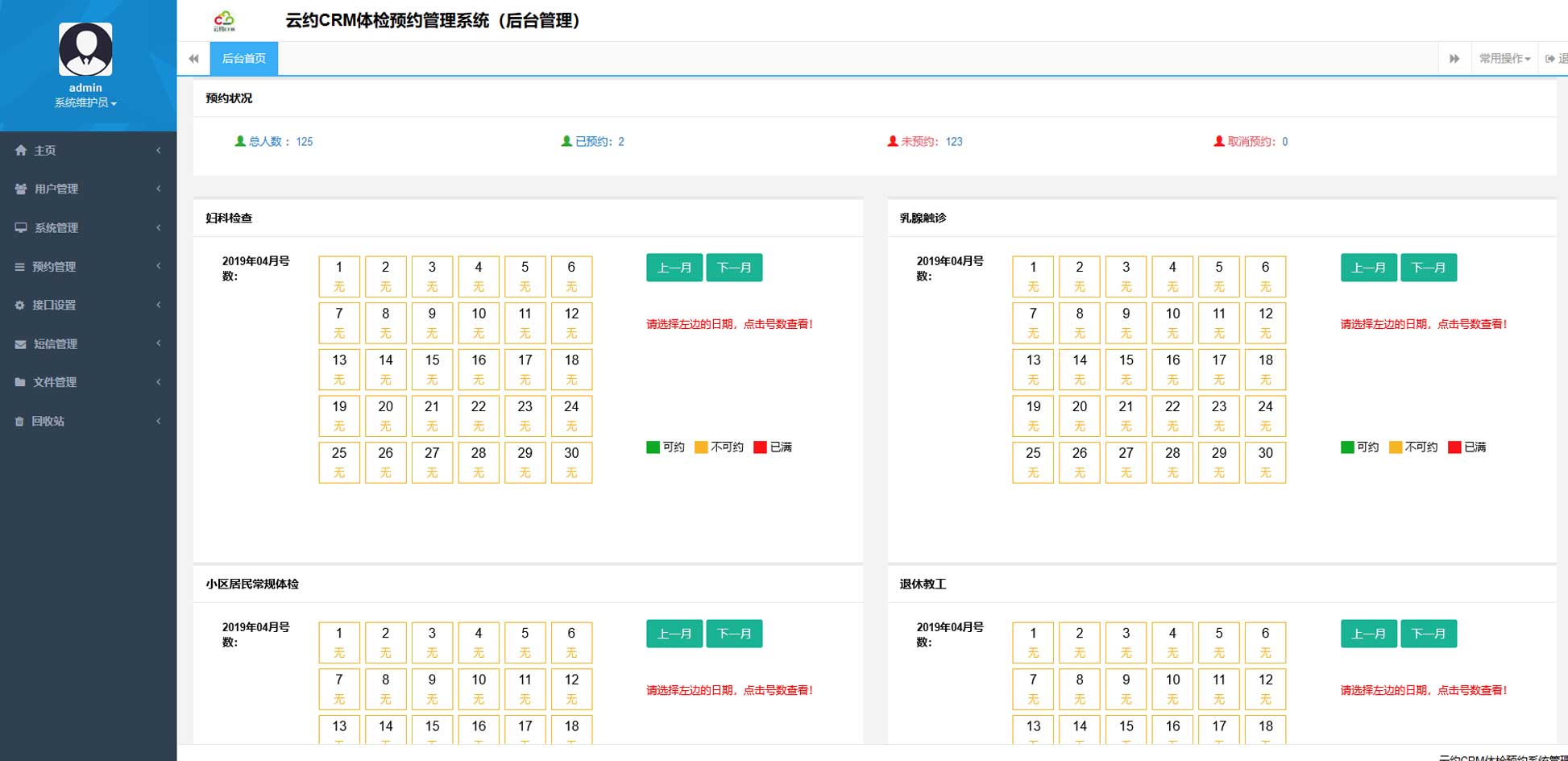

云约CRM微信小程序APP系统定制开发  云约CRM体检自定义出号预约管理系统

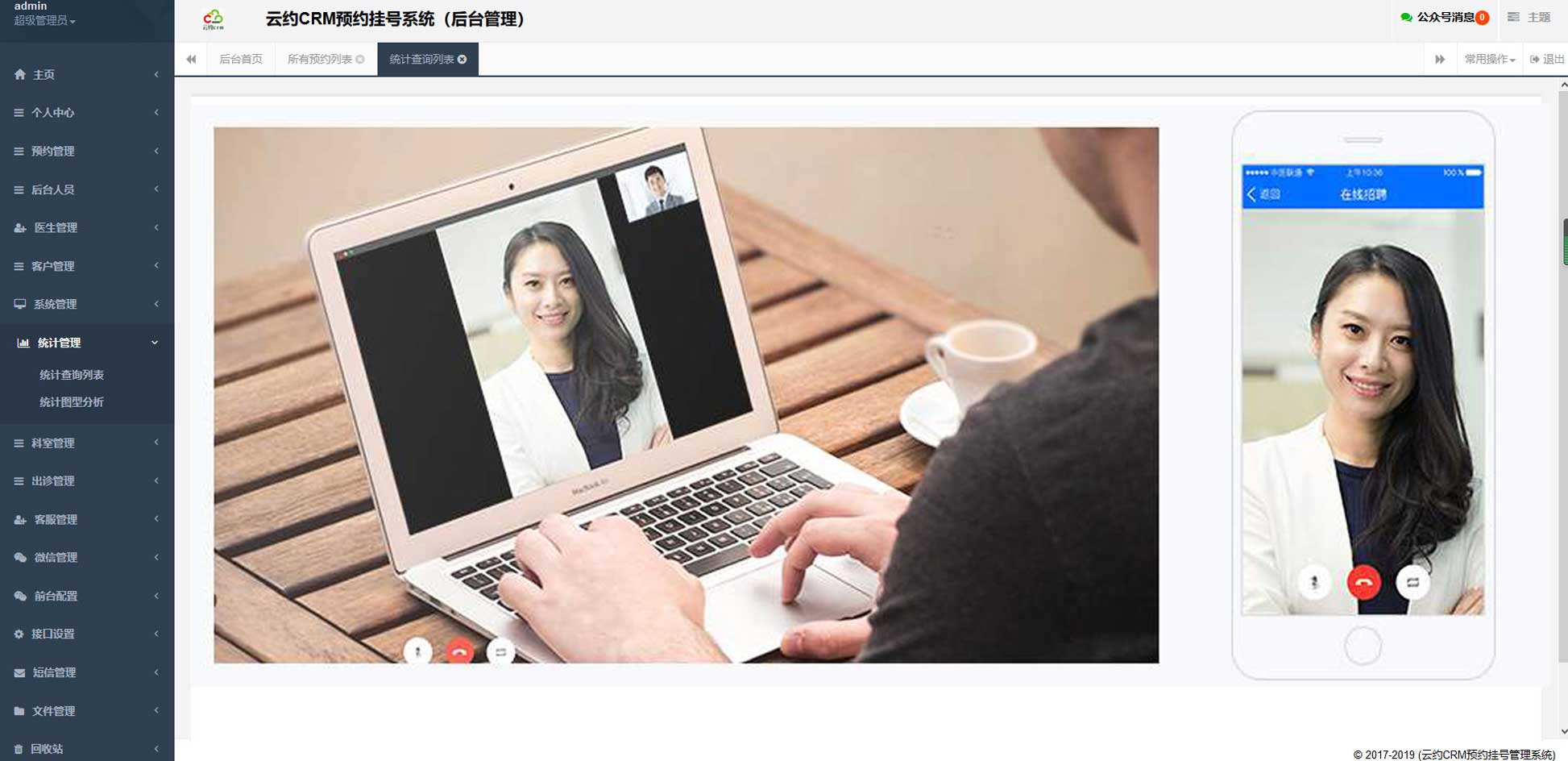

云约CRM体检自定义出号预约管理系统  云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统

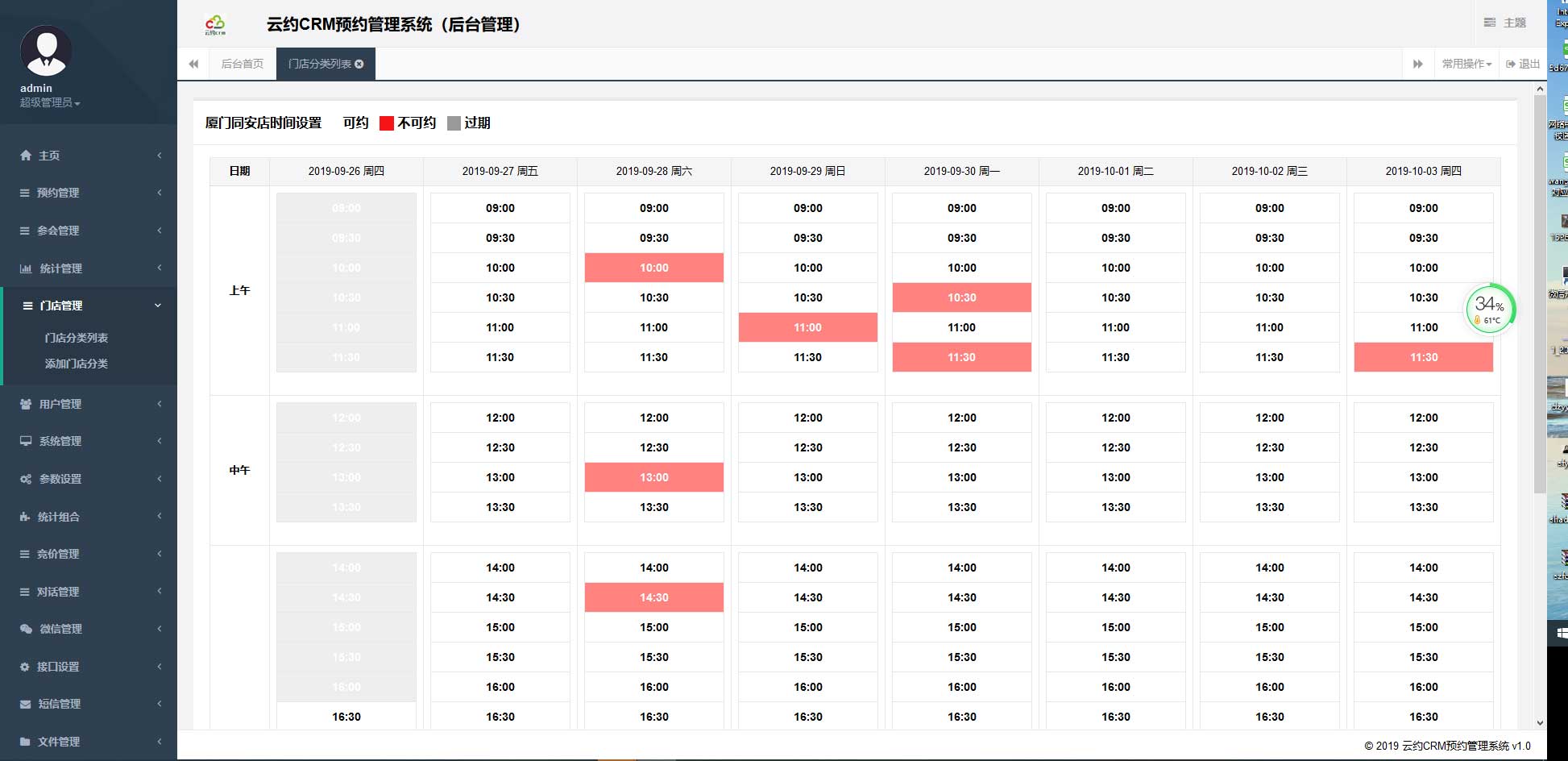

云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统  云约CRM新版美容微信预约系统门店版_门店预约管理系统

云约CRM新版美容微信预约系统门店版_门店预约管理系统 云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统

云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统联系电话:18300931024

在线QQ客服:616139763

官方微信:18300931024

官方邮箱: 616139763@qq.com