1、Transformer 是一种革命性transformer的神经网络架构transformer,它的核心创新在于自注意力机制,这使得模型能够有效处理长距离依赖关系和并行计算最初由谷歌 Brain 团队在 2017 年提出,旨在解决自然语言处理NLP领域中的问题,尤其是机器翻译任务自推出以来,Transformer 在多个领域展现transformer了其强大能力,不仅在 NLP 领域,还。

2、八总结Transformer模型通过注意力机制和独特架构,深刻改变了NLP,展示了在诸如机器翻译和情感分析等任务中的卓越性能探索Transformer的世界,将揭示更多深度学习在语言理解和生成方面的突破。

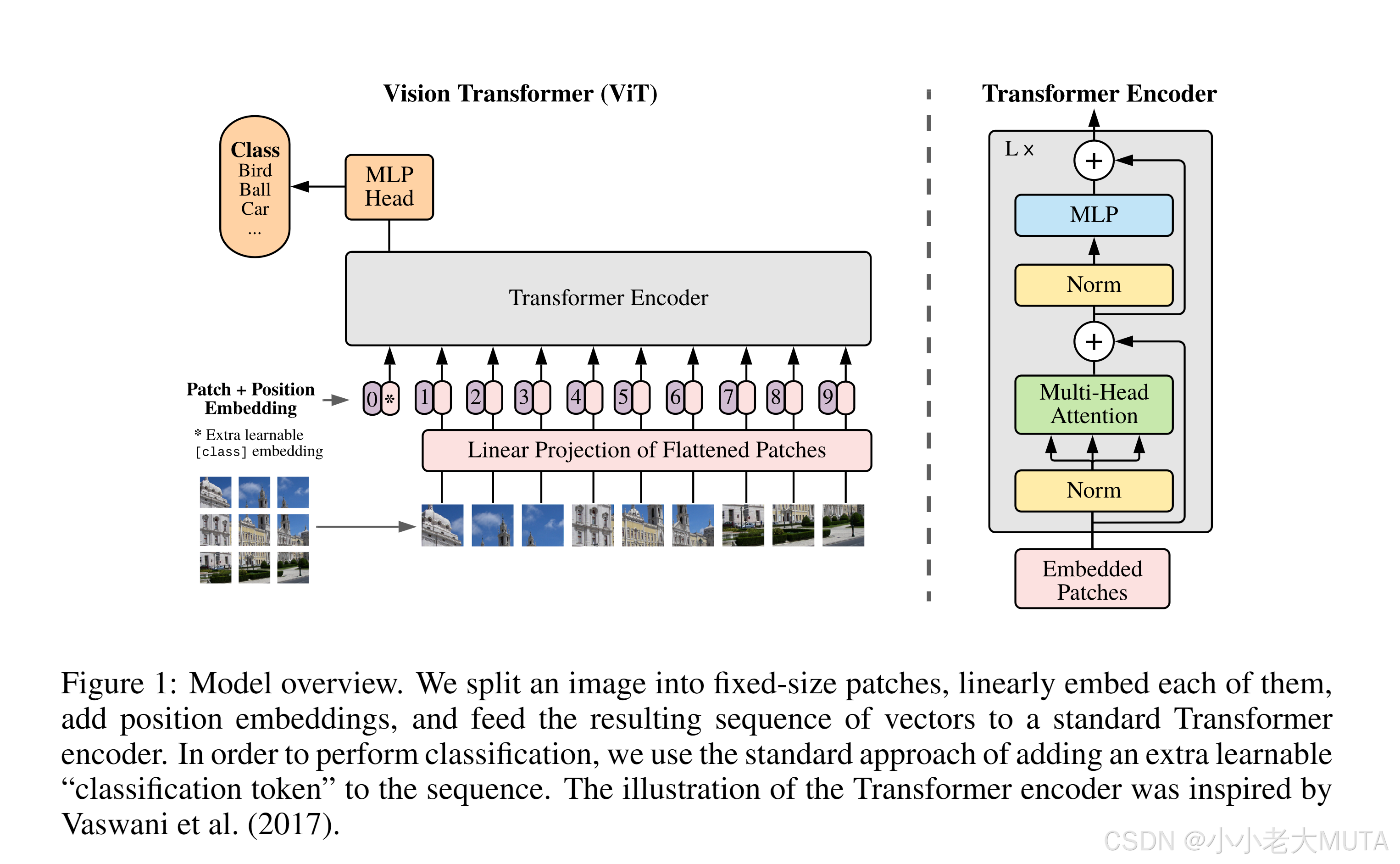

3、Transformer模型结构简介编解码器结构Transformer模型包括编码器和解码器,两者均由多个Transformer块组成这些块接收并输出向量序列,无需传统的循环结构,通过全注意力机制处理全局依赖关系Transformer块的关键模块多头注意力层解决长程依赖问题,非线性地整合上下文信息位置感知前馈层通过全连接层。

4、Bert是基于Transformer编码器结构的模型,只有Encoder部分而Transformer是由Encoder和Decoder组成的完整序列到序列结构的模型Bert的模型结构更简单,主要用于上下文语义理解任务,如文本分类文本相似度计算等Transformer可以应用于更复杂的任务,如机器翻译摘要生成等需要生成语言序列的任务2 预训练语料。

5、Transformer模型详解一模型概述 Transformer模型由论文Attention is All You Need提出,是当前自然语言处理领域的重要模型它由编码器和解码器两部分组成,每部分包含6个块模型通过自注意力机制实现高效并行化,简化了序列到序列任务的处理二输入表示 单词嵌入采用预训练方法如Word2VecGlove。

6、Transformer是一种专为文本数据设计的架构,输入一个文本序列,输出另一个文本序列比如,将英语句子转换成西班牙语核心结构由编码器堆栈和解码器堆栈组成,每个部分都有Embedding层接收输入,并通过输出层生成最终结果编码器和解码器结构类似,但各有其功能编码器是Transformer的核心组件,包含多层结构。

7、Transformer模型是一种用于处理序列数据的深度学习模型,最初是为自然语言处理NLP任务设计的Transformer由编码器Encoder和解码器Decoder两部分组成,通过自注意力机制来计算输入序列中各个位置之间的相关性,从而捕捉长程依赖关系这种机制使得Transformer能够并行处理输入序列的信息,大大提高了训练。

8、注意力机制是Transformer的关键它允许模型关注输入序列中与当前单词密切相关的其transformer他单词,如quotballquot与quotbluequotquotholdquot相关,但与quotboyquot与quotbluequot无关通过将输入序列中每个词与其他词关联,形成selfattention机制,Transformer能够处理句子意图和语义的细微差别,为每个单词赋予注意力打分,确保模型在解码时。

9、transformer中文名n变压器 网络 互感器变形金钢变换器 读音美 tr#230ns#712f#596rm#601r 英 tr#230ns#712f#596#720rm#601r例句1Bay, who has directed both of the immensely popular Transformer movies said he was working on a thir。

10、Transformer,以其强大性能在NLP领域独领风骚,自Attention is all you need论文提出后,便成为翻译模型性能提升的重要驱动力众多项目如BERT和GPT系列在此基础上拓展,成为NLP任务中的标准架构,尤其在面试中备受瞩目Transformer的核心是其编码器和解码器结构,以文本序列输入生成输出,如将英语翻译为。

11、Transformer模型是一个用于处理序列到序列任务的神经网络架构,尤其在机器翻译领域表现出色以下是对Transformer的详细解释一整体框架 Transformer模型接收一种语言的句子作为输入,输出另一种语言的对应翻译内部结构主要包括编码器和解码器,它们之间通过连接进行信息传递二编码器 编码器由多个编码单元。

12、Transformer模型,一种神经网络,通过学习序列数据中的关系,提升上下文理解能力它们在AI领域崭露头角,具备强大潜力,推动了机器学习的进展斯坦福大学认为它们是AI范式的推动者Transformer模型能够翻译文本语音,简化制造,预测趋势,防范欺诈,改善医疗保健它们在文本图像和视频数据处理中表现出色。

13、transformer 英 tr#230ns#712f#596#720m#601r 美 tr#230ns#712f#596#720rm#601rn#160#160变压器 牛津词典 noun 变压器a device for reducing or increasing the voltage of an electric power supply, usually to allow a particular piece of。

14、Transformer的工作原理其实很简单,它主要由两个线圈组成,一个是主线圈,另一个是副线圈这两个线圈通过一个铁芯相互连接当电流通过主线圈时,会在铁芯中产生一个磁场,这个磁场会在副线圈中感应出电动势电动势的大小与主线圈中的电流大小成正比,同时也与两个线圈之间的匝数比例有关具体来说。

15、Transformer模型的优点在于可以直接计算每个词之间的相关性,无需通过隐藏层传递信息,这使得模型在处理长依赖关系时表现优异同时,由于其并行计算的特点,Transformer能够充分地利用GPU资源,显著提高训练效率然而,Transformer也有其局限性首先,相较于RNN和CNN,它在捕捉局部信息方面表现较弱其次,位置。

上一篇: 服务控制台,谷歌应用服务控制台

下一篇: 如何制作电子杂志,如何制作杂志电子期刊

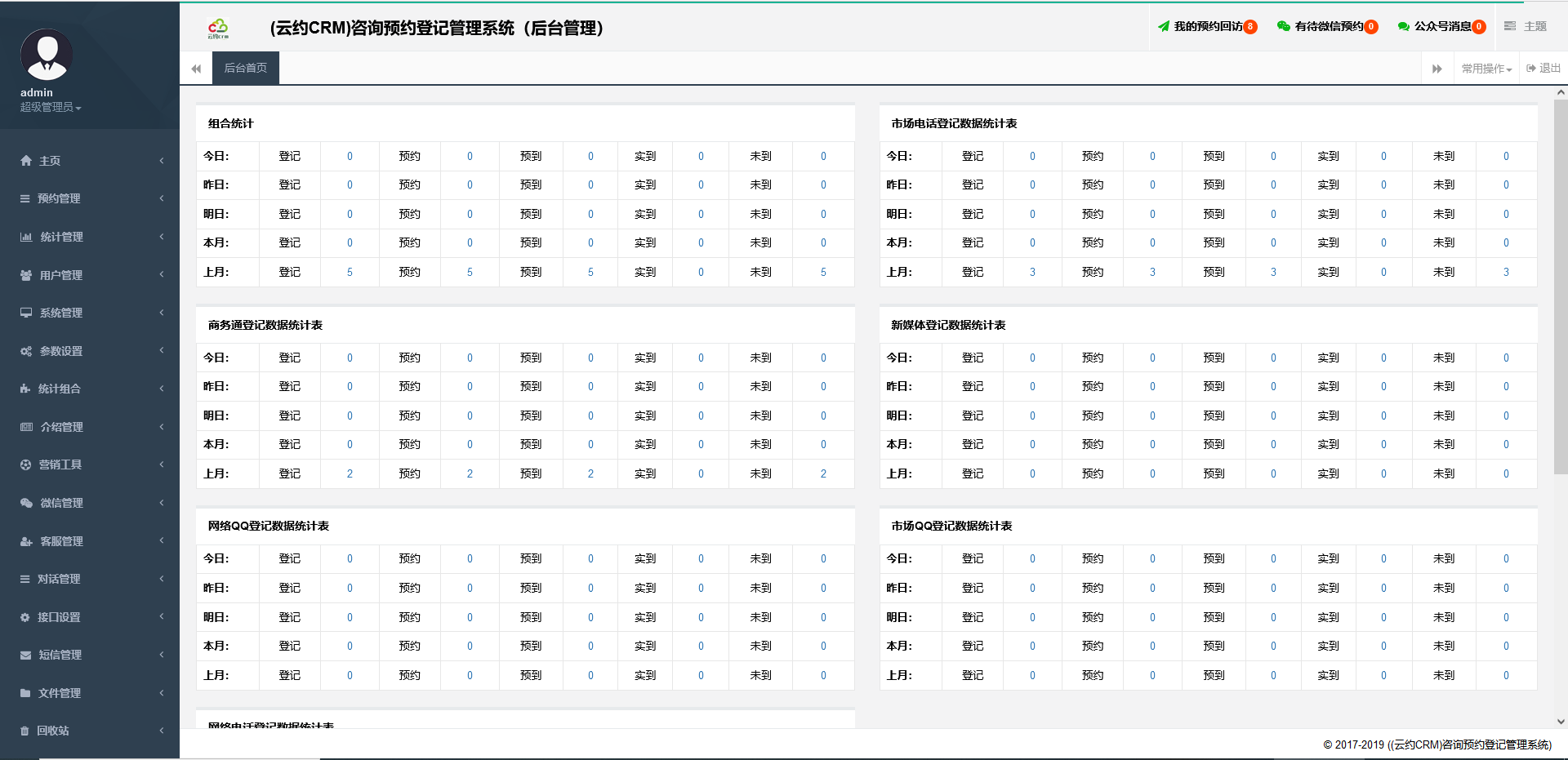

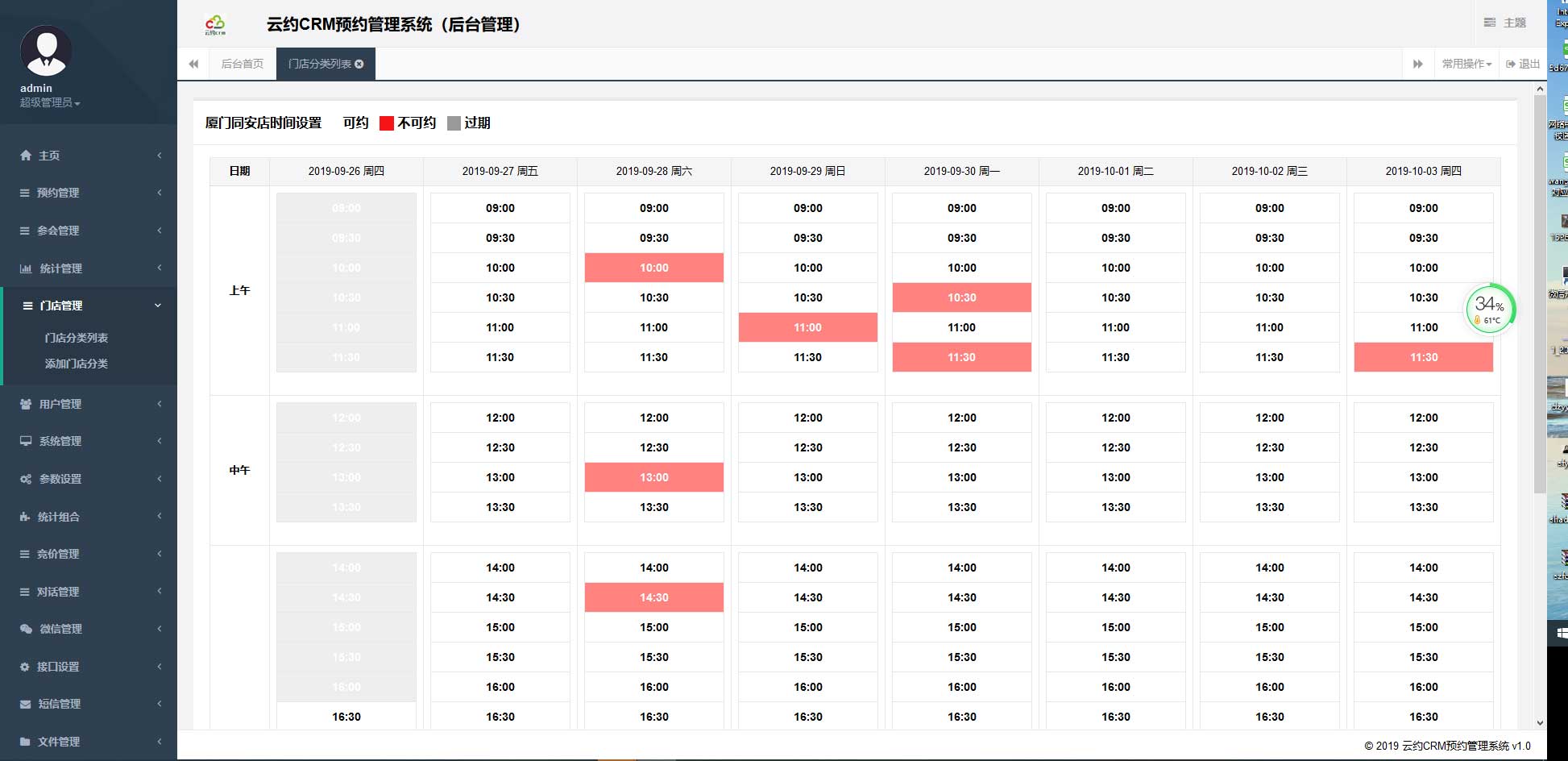

微信医疗(登记+咨询+回访)预约管理系统

微信医疗(登记+咨询+回访)预约管理系统  云约CRM微信小程序APP系统定制开发

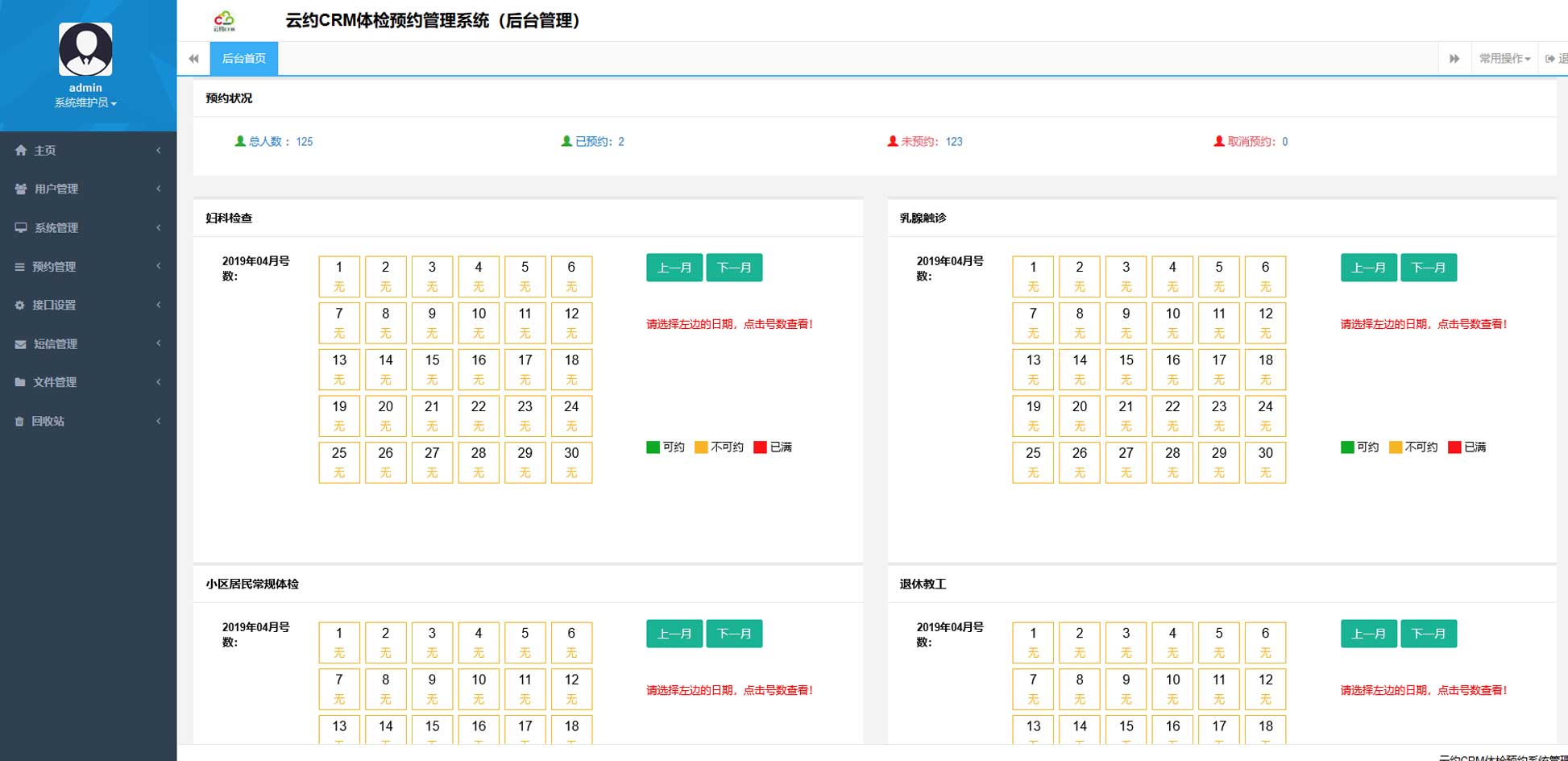

云约CRM微信小程序APP系统定制开发  云约CRM体检自定义出号预约管理系统

云约CRM体检自定义出号预约管理系统  云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统

云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统  云约CRM新版美容微信预约系统门店版_门店预约管理系统

云约CRM新版美容微信预约系统门店版_门店预约管理系统 云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统

云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统联系电话:18300931024

在线QQ客服:616139763

官方微信:18300931024

官方邮箱: 616139763@qq.com